تعلم بالتعزيز

التعلم التعزيزي[1] أو التعلم بالتعزيز (بالإنجليزية: reinforcement learning) هو مجال من مجالات التعلم الآلة يختص بكيفية جعل الوكيل المُبرمَج يتخذ القرار (الاختيار) في بيئة من أجل تعظيم المكافأة الكلية. التعلم المُعزَّز هو أحد فروع التعلم الآلى الثلاثة بجانب التعلم المراقب وغير المراقب.

يختلف التعلم المُعزَّز عن التعلم المراقب بأنه لا يحتاج إلى أي أزواج من المدخلات والمخرجات، ولا يحتاج إلى تصحيح القرارات (الاختيارات) غير المثالية بشكل مباشر. عوضًا عن ذلك، يتم التركيز على الأداء المباشر، الذي ينطوي على إيجاد توازن بين الاستكشاف (للفضاء غير المجهول) و الاستغلال (للمعرفة الحالية).

في مجال تعلم الآلة، عادة ما تصاغ البيئة كـعملية ماركوف لاتخاذ القرار (MDP) ، كما أن العديد من خوارزميات التعلم المُعزَّز في هذا السياق تستخدم تقنيات البرمجة الديناميكية. الفرق الرئيسي بين الأساليب التقليدية للبرمجة الديناميكية وخوارزميات التعلم المُعزَّز في هو أن الأخير لا يفترض الكثير من المعلومات عن الMDP، كما أنه يستطيع استهداف الMDP الكبيرة جدًا التي يصعب بها تطبيق الأساليب الدقيقة exact methods.

مقدمة

[عدل]

التعلم المُعزَّز مستوحى من علم النفس السلوكي، يعنى بكيفية اختيار الوكلاء البرمجيين للإجراءات في بيئة ما بشكل يحقق أقصى قدر لمفهوم ما من المكافأة. المشكلة، نظرا لعمومها، تدرس في العديد من التخصصات الأخرى مثل نظرية الألعاب، نظرية التحكم، بحوث العمليات، نظرية المعلومات، الاستمثال المحاكي، الأنظمة متعددة الوكلاء، ذكاء السرب، الإحصائيات والخوارزميات الجينية. في بحوث العمليات والتحكم، يسمى المجال الذي تدرس به أساليب التعلم المُعزَّز البرمجة الديناميكية التقريبية. كما يتم دراسة نفس المشكلة في مجال نظرية التحكم الأمثل، رغم أن معظم الدراسات هذا المجال معنية بوجود الحلول المثلى ووصفها، وليس بجوانب التعلم أو التقريب. في الاقتصاد ونظرية الألعاب، يمكن استخدام التعلم المُعزَّز لشرح كيفية إمكان نشأة حالة توازن في إطار عقلانية محدودة. وهو يعتبر إحدى فروع التعلم الآلى إلى جانب التعلم المراقب وغير المراقب.

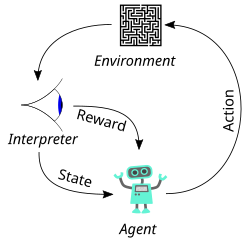

نموذج بسيط لللتعلم المُعزَّز باستخدام عملية ماركوف لاتخاذ القرار يكون على شكل:

- مجموعة من حالات البيئة والوكيل A

- مجموعة من القرارات (الاختيارات) S

غالبا ما تكون القواعد عشوائية. الرصد عادة ينطوي على المكافأة الفورية المرتبطة بآخر انتقال. في العديد من التطبيقات، يُفترض أن الوكيل يرصد الحالة البيئية الحالية (ما يسمى الرصد الكامل). إذا لم يكن كذلك فيقال أن لدى الوكيل رصد جزئي. في بعض الأحيان، مجموعة الإجراءات المتاحة للوكيل قد تكون مقيدة.

يتفاعل وكيل التعلم المُعزَّز مع بيئته في خطوات زمنية منفصلة. في كل زمن t، يتلقى الوكيل رصدًا عادة ما يشمل مكافأة . ثم يختار الوكيل إجراءًا من مجموعة الإجراءات المتاحة، والذي يتم إرساله إلى البيئة. تنتقل البيئة بعد ذلك إلى حالة جديدة ويتم التحديد المكافأة المرتبطة بالانتقال . هدف الوكيل في التعلم المُعزَّز هو جمع أكبر قدر من المكافأة. بإمكان الوكيل اختيار إجرائه كدالة لتاريخه أو حتى بطريقة عشوائية.

حين يقارن أداء الوكيل بأداء وكيل يعمل بطريقة مثالية، فإن الفرق في الأداء يؤدي إلى مفهوم الأسف. من أجل العمل بقرب من المثالية، على الوكيل الاحتساب للعواقب طويلة المدى لإجراءاته، ولو أدى ذلك إلى مكافأة فورية سالبة.

إذًا، فإن التعلم المُعزَّز مناسب بشكل خاص للبيئات التي تشمل مفاضلة بين المكافأة على المدى الطويل مقابل المدى القصير. وقد تم تطبيقه بنجاح لحل العديد من المسائل، بما فيها التحكم بالروبوت، جدولة المصاعد، الاتصالات السلكية واللاسلكية، لعبة الطاولة، لعبة الداما[2]ولعبة غو الصينية (AlphaGo).

عاملان يجعلان التعلم المُعزَّز أسلوبًا ناجحًا: استخدام العينات لتحسين الأداء واستخدام التقريب للتعامل مع البيئات كبيرة. بفضل هذين العنصريين، فإن التعلم المُعزَّز يمكن استخدامه في بيئات كبيرة في الحالات التالية:

- نموذج البيئة معروف، ولكن الحل تحليلي غير متاح؛

- لا يعرف إلا نموذج محاكٍ البيئة؛[3]

- الطريقة الوحيدة لجمع المعلومات عن البيئة هو التفاعل معها.

أولى اثنتين من هذه الحالات يمكن اعتبارها مسائل تخطيط (لأن النموذج متاح بشكل ما) ، بينما الحالة الأخيرة بالإمكان اعتبارها مسألة تعلم فعليّة. ولكن، تحت إطار منهجية التعلم المُعزَّز فإن كلتي مسائل التخطيط يتم تحويلها إلى مسائل التعلم الآلي.

الاستكشاف

[عدل]المفاضلة بين الاستفادة (الاستغلال) من الحالة الحالية أو الأستكشاف دُرست بشكل مفصل في التعلم المُعزَّز من خلال مشكلة الأذرع المتعدة multi-armed bandit. يحتاج التعلم المُعزَّز أسلوب ذكى لتحديد الكم من الإستكشاف، حيث أن اختيار الخيارات actions عشوائيا ينتج عنه أداء ضعيف.

أحد هذه الطرق الشهيرة هي طريقة ايبسلون-جشع (وهي تعنى دوماً اختيار أفضل حل في كل مرة مع بعض العشوائية بقيمة ايبسلون -قيمة صغيرة). حيث دوما ايبسلون قيمتها تتراوح ما بين الصفر والواحد، ويولد رقم عشوائى عندما يكون أكبر من ال يُختار الأختيار الطبيعى (الأكبر) وعندما يكون الرقم المُولد العشوائى أصغر من يُختار أختيار عشوائى كنوع من الاستكشاف.

مقارنة بين خورازميات التعلم المُعزَّز

[عدل]| الخوارزم | الوصف | إعتماده على نموذج | الخطة المتبعة | فضاء الخيارات | فضاء الحالات | الدالة الأساسية |

|---|---|---|---|---|---|---|

| مونت كارلو Monte Carlo | يعمل بكل زيارة في دورة مونت-كارلو | لا يعتمد | يعمل في الحالتين | متقطع | متقطع | متوسط العينة |

| تعلم الدالة ق Q-learning | حالة-خيار-مكافأة-حالة | لا يعتمد | لا يعتمد على خطة | متقطع | متقطع | قيمة ق Q-value |

| SARSA | حالة-خيار-مكافأة-حالة-اختيار | لا يعتمد | يعتمد على خطة | متقطع | متقطع | قيمة ق Q-value |

التعلم المُعزَّز العميق

[عدل]تستخدم هذه الخوارزميات المفاهيم الأساسية للتعلم المُعزَّز بدمجها مع الشبكات العصبيية لتكون deep reinforcement learning وذلك في حالة كبر فضاء الحالة state space وصعوبة تمثيله بالطرق التقليدية.

التعلم المُعزَّز العكسي

[عدل]في هذا المجال لا يعطى الوكيل دالة المكافأة مباشرة وانما يشاهد الطرق الصحيحة لفعل هذا العمل والمكافأة التي يحصل عليها. ثم عليه أن يحاكى (يتعلم) من المشاهدات تلك ما هي الخيار الصحيح للحصول على المكافأة السليمة.

انظر أيضًا

[عدل]المراجع

[عدل]- ^ معجم البيانات والذكاء الاصطناعي (PDF) (بالعربية والإنجليزية)، الهيئة السعودية للبيانات والذكاء الاصطناعي، 2022، ص. 100، QID:Q111421033

- ^ Sutton Barto.

- ^ Gosavi 2003.